Geek / Diciembre 18, 2025

La memoria RAM sube de precio: IA y la tensión por el hardware global

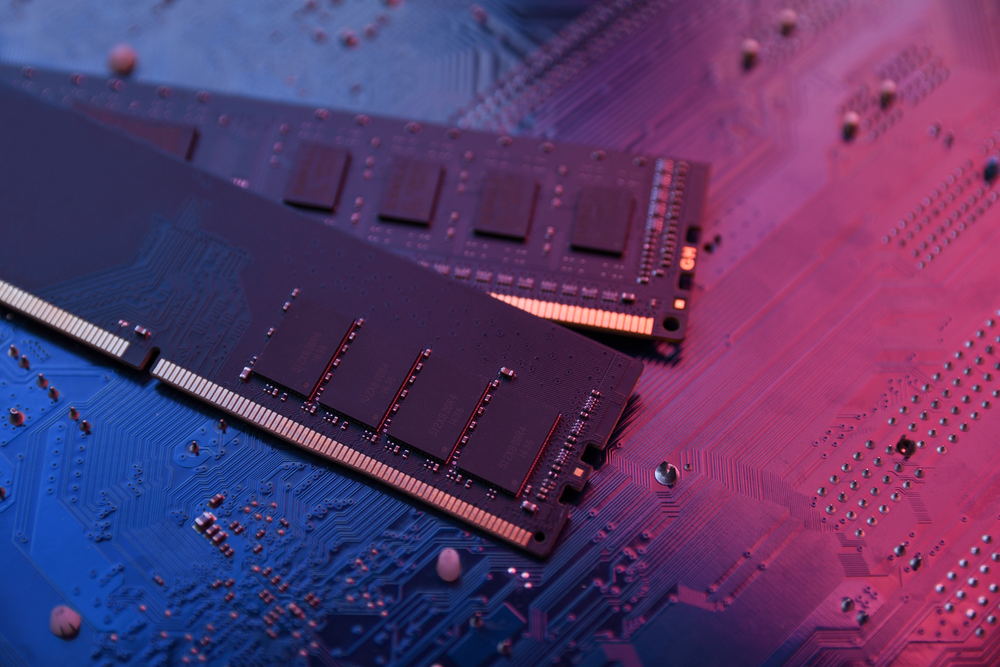

En las últimas semanas, la memoria RAM volvió a ocupar los titulares por una razón particular: distintos medios reportan grandes alza en el precio, con proyecciones de que podrían extenderse durante 2026.

Este componente dejó de ser secundario para convertirse en un punto crítico de la cadena tecnológica global, y la inteligencia artificial pareciera empujar la demanda de memoria a un ritmo que la oferta no está alcanzando.

El alza de precios no responde a una moda pasajera ni a un pico puntual de demanda, sino a un reordenamiento profundo de prioridades industriales, impulsado por la expansión acelerada de la inteligencia artificial.

Qué está pasando con la RAM y por qué se encarece

La industria de memoria opera en ciclos largos: planificar capacidad, fabricar, empaquetar, testear y despachar no se resuelve de un mes a otro. Cuando un nuevo comprador llega dispuesto a pagar más, el mercado se mueve hacia él. En 2025 y 2026, ese comprador es la IA: modelos más grandes, más usuarios y más data centers.

El resultado es simple: las fábricas priorizan lo que deja mejores márgenes de ganancia, y el stock disponible para el mercado “normal” se vuelve más escaso y/o más caro. Un ejemplo muy comentado es la presión sobre las memorias DDR5 y DDR4, con reportes de alzas contractuales agresivas en DDR5 por escasez de inventario, que amarra el stock actual y futuro a grandes empresas tecnológicas.

Data centers: El “mejor postor”

En el mercado de semiconductores, quien asegura volumen y paga por adelantado suele tener preferencia. En el auge de la IA, empresas como OpenAI, Google y Meta, junto a sus socios de servicios en la nube, no compran “módulos”: reservan capacidad productiva. Es decir, no solo adquieren memoria, sino que bloquean suministro futuro, empujando a proveedores a dedicar líneas a lo que necesitan los clusters de entrenamiento para LMM’s.

Esto se ve potenciado por la carrera de infraestructura. Se están construyendo data centers a escala histórica, lo que sube la demanda de GPU, redes, energía y memoria de forma simultánea. En este escenario, el componente que se vuelve más crítico suele ser el que no se puede improvisar: memoria especializada para acelerar IA.

Esta dinámica se entiende mejor cuando se mira el contexto de “carrera armamentista” tecnológica, donde la presión competitiva obliga a acelerar gasto y capacidad. Si te interesa este tema, puedes leer: OpenAI Code Red y la burbuja de la inteligencia artificial.

RAM “normales” vs memoria para LLM

Cuando hablamos de “RAM”, en realidad estamos mezclando familias de productos con usos muy distintos:

RAM de uso común

Es la memoria que usan PCs y notebooks (DDR4, DDR5), muchos servidores tradicionales y parte del mercado móvil. Su prioridad es equilibrio entre costo, disponibilidad y rendimiento general. Cuando sube su precio, el impacto es inmediato: notebooks más caras, PCs más caras o, en algunos casos, equipos con menos memoria para mantener márgenes.

Memoria orientada a IA

Para acelerar modelos de IA, la industria usa cada vez más HBM (High Bandwidth Memory), una memoria de muy alto ancho de banda que se integra cerca del procesador gráfico o acelerador. Fabricarla consume más recursos productivos que la DRAM estándar. Por ejemplo, Micron ha señalado que HBM utiliza mucha más capacidad de fabricación (más “wafer space”) que DDR5, lo que tensiona la oferta de memoria para el resto del mercado.

Esta distinción es clave porque explica el efecto dominó: aunque tú compres RAM “normal”, compites indirectamente con la prioridad industrial por HBM. Si la fábrica destina líneas y materiales a HBM, queda menos margen para DDR y el precio se sube.

Un círculo de inversión que se retroalimenta

La cadena se parece a un circuito cerrado:

- NVIDIA domina el hardware de cómputo para IA y vende GPUs a escala masiva.

- Las compañías de IA y nube levantan capital, firman acuerdos y reservan infraestructura.

- Ese dinero se convierte en compras anticipadas de GPU, redes y memoria.

- Los fabricantes priorizan pedidos grandes, estables y de mejor margen.

- El hardware de consumo absorbe el golpe: menos stock, mayor precio o recorte de especificaciones.

En paralelo, algunos analistas y medios han observado que esta presión puede acelerar decisiones incómodas en fabricantes: volver a configuraciones más austeras para no subir precios finales, especialmente en smartphones y equipos de entrada.

Impacto real: quién paga la cuenta

Cuando el costo de componentes sube, hay tres salidas posibles:

- Subir precios de notebooks, PCs, consolas y teléfonos.

- Reducir especificaciones para mantener el precio (menos RAM, menos almacenamiento, ciclos de renovación más lentos).

- Absorber margen, lo que presiona a retailers y fabricantes, y suele durar poco.

En escenarios extremos, incluso se habla de “RAMageddon” para describir la presión acumulada sobre la cadena de suministro. Micron ha sugerido que los desequilibrios podrían persistir más allá de 2026.

En Agencia Digital ya hemos visto cómo la dependencia de infraestructura puede amplificar impactos a nivel global. Para dimensionar ese riesgo sistémico, revisa: La caída de Cloudflare y el impacto global en internet.

Brújula 2026

Sin alarmismo, ni pánico, hay señales concretas a observar:

- Prioridad HBM: mientras la demanda de IA siga creciendo, seguirá compitiendo por capacidad productiva.

- Contratos y reservas: los acuerdos de suministro a largo plazo tienden a desplazar al comprador “spot”.

- Costos de data centers: energía, refrigeración y conectividad presionan el costo total de la IA, y eso afecta el ritmo de expansión.

- Reacción del consumo: si los dispositivos suben demasiado, la renovación se desacelera y el mercado ajusta por la vía del volumen.

En este escenario, el gran dilema es que la economía de la IA exige infraestructura cada vez más cara, y al mismo tiempo depende de un mercado que no siempre paga el costo real de ese cómputo.

Te recomendamos entender otras alianzas tecnológicas recientes: Disney invierte en OpenAI: derechos de autor y financiamiento.

Preguntas frecuentes

¿Por qué sube el precio de la RAM si yo no uso IA?

Porque la industria de memoria comparte capacidad productiva y materiales. Si las fábricas priorizan memoria especializada para IA (como HBM), queda menos disponibilidad para RAM de consumo (DDR4/DDR5), y el precio se recalienta.

¿Qué es HBM y por qué importa para los LLM?

HBM (High Bandwidth Memory) es una memoria de alto ancho de banda diseñada para trabajar muy cerca de GPUs/aceleradores. Es clave para entrenamiento e inferencia a gran escala, pero su fabricación consume más recursos industriales que la DRAM estándar.

¿Esto afecta solo a PCs “gamers”?

No. Afecta a notebooks, PCs de oficina, servidores, teléfonos y cualquier dispositivo que dependa de DRAM. El impacto puede verse como subida de precios o recorte de especificaciones.

¿La situación se resolverá pronto?

Probablemente no de inmediato. La capacidad nueva de fabricación tarda años en entrar en operación y, según ejecutivos del sector, la tensión de oferta y demanda podría extenderse más allá de 2026.

¿Qué puede hacer el consumidor?

Comparar precios con más paciencia, evaluar compras antes de picos estacionales y priorizar configuración (RAM/almacenamiento) según uso real. En empresas, conviene planificar renovaciones y contratos con anticipación.